NVIDIA-Hardwareplattform und CarMaker trainieren Deep-Learing-Algorithmen

Wird die Hardwareplattform von NVIDIDA mit der Simulationssoftware CarMaker verknüpft, lassen sich Deep-Learning-Algorithmen für den virtuellen Fahrversuch trainieren. Damit sollen sichere Systeme für selbstfahrende Autos möglich werden.

Anbieter zum Thema

Wie bringt man ein Fahrzeug dazu, selbstständig und autonom zu fahren? Man lässt es bei echten Fahrern zuschauen und lernen. Möglich macht das die offene Computing-Plattform DRIVE PX 2 von NVIDIA. Das Besondere der Hardwareplattform ist die Graphics Processing Units (GPUs). Mit ihr lassen sich neuronale Netze und Deep Learning-Anwendungen schneller entwickeln und testen, als wenn eine herkömmliche CPU zum Einsatz kommt.

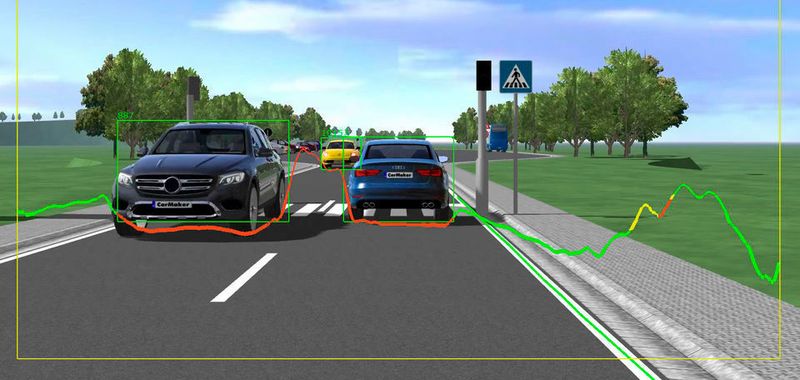

Die auf neuronalen Netzen basierenden Algorithmen erkennen schon nach Kurzem in Echtzeit, wie andere Verkehrsteilnehmer oder Verkehrsschilder aussehen und ermöglichen selbst in komplexen Verkehrssituationen eine Orientierung im Straßenverkehr. Die Simulationssoftware CarMaker kann mit der NVIDIA-Hardwareplattform verknüpft und zum Training von neuronalen Netzen im virtuellen Fahrversuch verwendet werden. Darüber hinaus ermöglicht es die Verknüpfung, auch Deep Learning-Sensorfusionsalgorithmen zur Steuerung von Fahrerassistenzsystemen und automatisierten Fahrfunktionen virtuell zu entwickeln und testen.

360-Grad-Umgebung in Echtzeit

Die NVIDIA-Grafikprozessoren sind so leistungsfähig, dass sie auch für die Interpretation von Sensordaten einsetzbar sind. Die Daten von bis zu zwölf Kameras sowie von Lidar-, Radar- und Ultraschallsensoren können ausgewertet werden und so eine vollständige 360-Grad-Umgebung in Echtzeit abbilden. Deep Neural Networks (DNN) ermöglichen bei der Erkennung und Klassifizierung von Objekten eine hohe Genauigkeit der Ergebnisse aus den zusammengelaufenen Sensordaten und lassen das autonome Auto präzise und auf einer sicheren Route fahren, die angepasst an die jeweiligen Umstände ist.

Die Simulationslösungen der CarMaker-Produktfamilie und der NVIDIA-Hardwareplattform miteinander zu verknüpfen, eröffnet den Entwicklungsabteilungen der Fahrzeughersteller und Zuliefererindustrie auch die Möglichkeit, frühzeitig Fahrerassistenzsysteme und automatisierte Fahrfunktionen im virtuellen Fahrversuch zu testen. Bislang wurde dem neuronalen Netz ein reales Fahrvideo mit entsprechenden Daten zu Fahrbahnmarkierungen, Verkehrsteilnehmern, Gebäuden oder geparkten Autos in verschiedenen Sicht- und Wetterverhältnissen wie Wolken, Nebel, Schnee und Regen, Tag oder Nacht vorgespielt. Mithilfe von CarMaker lassen sich reproduzierbare Daten unterschiedlichster Szenarien virtuell erzeugen und zum Training der neuronalen Netze verwenden.

Kamerabilder sind mit Steuergerät verknüpft

Verknüpft mit der Video-Interface-Box sind zudem Closed-Loop-Testverfahren von Kamerasteuergeräten durch direkte Bildeinspeisung möglich. Beim Testen von Fahrerassistenzsystemen auf sogenannten Hardware-in-the-Loop-Prüfständen kann es aufgrund der fehlenden Synchronisation zwischen Bildaufbau im Monitor und der Bilderfassung in der Kamera zu zerrissenen Bildern kommen. Gleichzeitig sind digitale Flachbildschirme zu licht- und kontrastschwach, um Eingangsdaten für Lichtassistenzfunktionen liefern zu können.

Ebenfalls ist es möglich über GMSL (Gigabit Multimedia Serial Link) Bilder der Simulationsumgebung direkt in das NVIDIA DRIVE PX 2 einzuspeisen. Im Closed-Loop-HIL-Verfahren kann die Video-Interface-Box kamerabasierte Funktionen mit weiteren Steuergeräten inklusive der simulierten Umfeldsensorik überprüfen und somit die Vorteile des virtuellen Fahrversuchs auch im Kontext einer Sensordatenfusion nutzen.

:quality(80)/images.vogel.de/vogelonline/bdb/1394300/1394374/original.jpg)

Virtueller Fahrversuch: Aktuelle Version 7.0 von CarMaker mit neuen Funktionen

:quality(80)/images.vogel.de/vogelonline/bdb/1389300/1389314/original.jpg)

Autonomes Fahren und E-Mobilität – Künstliche Intelligenz sichert Funktion ab

(ID:45341410)

:quality(80)/p7i.vogel.de/wcms/f7/bb/f7bbc8b3f3d4ee8bc785031aea4dc59c/0131007959v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/99/ac/99ac15293609c5b05b2404fb9c26a3a6/0130768137v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/e5/9f/e59fd8d9f9c7f30437b2ce40d61e8ff6/0130925956v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/39/92/3992022e63899fa73fb05fab0a587bc7/0130916056v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/9a/04/9a04a7fc4c6e20d16ab078279afc585a/0131074974v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/52/13/5213188f308011e7f04ba5439cb0c811/0131060794v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ca/97/ca97fada68708534d436a6fbd91d6d61/0131057467v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/5f/96/5f9665cfeca3ca829105672721b0aeb8/sdv-heroimage-iar-6000x3372v1.png)

:quality(80)/p7i.vogel.de/wcms/07/99/079956e324dc36446812d2394b1f3a3e/0131020383v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/7d/4c/7d4ce3c21dbf39c650fde107bb8f5ae7/0131003679v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/71/90/7190bbc6889654cceaaf370cdd2fe85a/0130972050v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/c6/ab/c6ab333d0edc1486176f564fcc67b590/0130967702v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/c3/68/c368a3ad72ac970809451c311e05a07b/0127817359v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/6a/4f/6a4f63cfca5e01026d25edd19b5302c5/0127761368v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/42/86/4286fd057b5413102fbac1758d2dc55f/0127713923v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/36/49/36496a26b0c295de6d9a36d66ea7571a/0125402418v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/82/9a/829af2f01c704d3e3eaf802bc1099733/0128290644v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/23/2c/232c72b7536b0208632e3c4d69baa8f8/0130819693v2.jpeg)